GeForce 7800 GTX: recenzja i test

Autor: Kris | Data: 06/07/05

|

Pomimo przejściowych problemów z wygospodarowywaniem czasu, niezbędnego do pisania recenzji, pojawienie się nowego lidera wydajności wśród kart graficznych nie mogło pozostawić mnie obojętnym. Dzięki uprzejmości firmy nVidia, która udostępniła mi referencyjną kartę GeForce 7800 GTX oraz firm Gigabyte, MSI, Gainward, AMD i Sapphire, które umożliwiły mi skompletowanie platformy sprzętowej i zestawu do porównań wydajności, mam niewątpliwą przyjemność podzielenia się z Czytelnikami wynikami testów oraz wnioskami płynącymi z kilkudniowego obcowania z najnowszym produktem nVidia. Zapraszam do stosunkowo krótkiej, choć mam nadzieję, że treściwej recenzji. Pomimo przejściowych problemów z wygospodarowywaniem czasu, niezbędnego do pisania recenzji, pojawienie się nowego lidera wydajności wśród kart graficznych nie mogło pozostawić mnie obojętnym. Dzięki uprzejmości firmy nVidia, która udostępniła mi referencyjną kartę GeForce 7800 GTX oraz firm Gigabyte, MSI, Gainward, AMD i Sapphire, które umożliwiły mi skompletowanie platformy sprzętowej i zestawu do porównań wydajności, mam niewątpliwą przyjemność podzielenia się z Czytelnikami wynikami testów oraz wnioskami płynącymi z kilkudniowego obcowania z najnowszym produktem nVidia. Zapraszam do stosunkowo krótkiej, choć mam nadzieję, że treściwej recenzji.

| |

|

Teoria

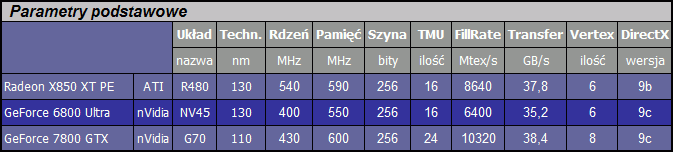

GeForce 7800 GTX jest pierwszą kartą opartą na układzie G70, którego premiera miała miejsce 22 czerwca 2005. Jego architektura wywodzi się wprost z linii NV4x, choć dokonano kilku istotnych zmian, na które chciałbym zwrócić szczególną uwagę.

Układ G70 składa się z rekordowej ilości 302 mln tranzystorów. Dla porównania, rdzeń GeForce 6800Ultra miał 222 mln, a Radeon X850XT PE 160 mln. Dzięki przejściu na technologię krzemową 0.11um udało się utrzymać zarówno stosunkowo wysokie taktowanie 430MHz, jak i zachować ten sam poziom wydzielanej przez układ mocy.

Zdecydowanie najważniejszą zmianą, w stosunku do poprzednika, jest dodanie do potoków pikseli ośmiu jednostek cieniowania. Mamy więc pierwszego na świecie 24-potokowca (poprzednia generacja miała do 16 potoków). W przypadku nowych układów pojęcie potoków jest raczej umowne, ponieważ nie zmieniono ilości modułów ROP (Raster Operation), odpowiedzialnych za końcową część procesu cieniowania. Układ faktycznie jest w stanie wykonywać 24 jednoczesne operacje, ale w jednym cyklu zegara zapisuje do pamięci "jedynie" 16 gotowych pikseli. Podobnie, jak i jego poprzednik. Dzięki temu udało się ograniczyć wielkość rdzenia przy niewielkiej, realnej utracie mocy przetwarzania. Ten sam trik sprawdził się w przypadku kart serii 6600, a idea bazuje na optymalizacji zależności czasowych pomiędzy poszczególnymi etapami procesu cieniowania pikseli.

Oprócz zmian ilościowych w potokach mamy też do czynienia z usprawnieniem działania samych shaderów. Do bloku przetwarzania dodano tzw. Mini-ALU (pomocnicze jednostki arytmetyczno-logiczne) odpowiedzialne za przyspieszenie konkretnych operacji matematycznych. Jak już wspominałem w starszych artykułach, metoda przetwarzania układów nVidia opiera się na większej ilości specjalizowanych instrukcji, wymagających większej ilości cykli zegara. Opracowując nową mutację układu, można w wyniku analizy zachowania shaderów odnaleźć wąskie "gardła" procesu i dokonać korekty poprzez dodanie niewielkiej, dedykowanej jednostki pozwalającej rozładować konkretne spiętrzenia danych, oczekujących na przetworzenie. Podobne "implanty" zastosowano z powodzeniem np. przy unowocześnianiu NV30 i również mamy z nimi do czynienia w G70.

Wraz z nowym układem dostajemy również znacznie lepszy moduł PureVideo. Jest to specjalizowana jednostka, odpowiedzialna za zdjęcie z procesora obciążenia, związanego z przetwarzaniem strumienia obrazu (filtrowanie, akceleracja kodowania/dekodowania, usuwanie przeplotu, korekcja koloru itd.). Pierwsza wersja PureVideo pojawiła się wraz z GeForce 6800 Ultra i ... nie działała. W kolejnych mutacjach rdzenia poprawiono błąd, a w serii 6600 wprowadzono kilka ulepszeń. Wraz z G70 dostajemy drugą generację PureVideo m.in. ze wsparciem sprzętowym dla HD WMV, którego zabrakło w poprzedniej wersji i wieloma innymi udogodnieniami, którymi nie dysponuje aktualnie konkurencja (no może oprócz najnowszych układów S3 serii GammaChrome).

Bezpośredni wpływ na wydajność 3D ma również dodanie dwóch jednostek Vertex Shader. G70 ma ich łącznie 8. Nic konkretnego nie można jednak napisać o ich zmianach jakościowych. Nadal brak jest filtrowania i nie można spodziewać się zmiany generacji w tej części obsługi efektów SM3.0, choć nVidia chwali się pewnym poprawieniem działania HDR (High Dynamic Range). Tu jednak mam dosyć sceptyczne podejście, bo nawet jeśli udało im się uzyskać 50% wzrost wydajności, to nie widzę szansy na to, że pojedyncza karta da sobie radę z tym efektem powyżej 1024x768 przy sensownym framerate.

Operacja tworzenia przez nVidia układu G70 przypomina proces przejścia ATI od R9800Pro do X800XT. Charakter zmian głównie zmierza w kierunku poprawienia wydajności przy minimalnych zmianach w architekturze pojedynczych potoków. Efekt osiągnięto dzięki zmianie technologii wytwarzania, co umożliwiło upchnięcie dodatkowych potoków, a całość uzupełnia kilka miłych dodatków i "tuning" samych jednostek obliczeniowych. W związku z tym, że konkurencja ma mniejsze możliwości w zakresie przetwarzania efektów 3D, to strategia nVidia wydaje się całkowicie uzasadniona. Do przewagi technologicznej dorzucono znaczące przebicie wydajnością i teraz piłka powędrowała do ATI. Kanadyjczycy mają znacznie więcej do zrobienia więc nVidia może spokojnie czekać na ich ruch.

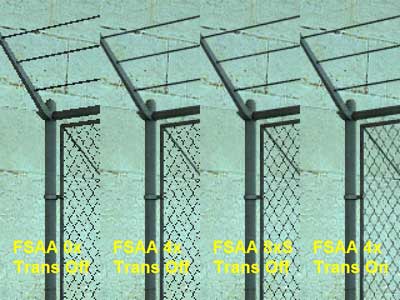

Transparent FSAA

Aby można było skutecznie reklamować nowy układ, musi się on wykazać się konkretnym, nowym efektem 3D. W przypadku G70 jest to funkcja Transparent FSAA. Wygładzanie "schodków" za pomocą klasycznego multisamplingu nie dotyka wnętrza tekstury, natomiast metoda supersamplingu (rendering całego obrazu w wyższym trybie) koszmarnie obciąża układ. Jeśli ramka zawiera przezroczystą teksturę z widokiem cienkich, ukośnych linii (trawa, siatka ogrodzenia itd.), to efektem jest pogorszenie ich jakości. Nowa metoda ma temu zapobiec, z minimalnym kosztem framerate.

Transparent FSAA włącza się z poziomu zaawansowanych ustawień jakości w najnowszych sterownikach. Mamy do wyboru "przezroczyste wygładzanie krawędzi" metodą "próbkowania wielokrotnego" (multisampling) lub "próbkowania super" (supersampling). Nazwy zaimportowałem bezpośrednio z określeń rodzimej wersji językowej sterownika nVidia.

Oczywiście spróbowałem obu ustawień i w przypadku drugiej metody (supersampling) efekt jest widoczny.

(kliknij, aby powiększyć)

W większości typowych testów specjalnej różnicy w wynikach nie zaobserwowałem. Najlepiej widoczna jest w postaci chwilowej wartości framerate w miejscu występowania takich tekstur. W pokazanym na zrzutach przykładzie włączenie Transparent FSAA metodą supersamplingu konsumuje mniej niż 20% klatek na sekundę, więc moim zdaniem jest to koszt całkowicie akceptowalny.

Choć nVidia specjalnie się tym nie chwali, to nowy układ wspiera również funkcję 3Dc. Jest to metoda bezstratnej kompresji tekstur użytych do obrazowania wypukłości metodą "normal map". Algorytm wprowadzony został przez ATI i promowany jest jako otwarty standard, z czego skorzystał nowy GeForce. Więcej informacji na ten temat można znaleźć w recenzji kart Radeon serii X800. Należy jednak pamiętać, że w przypadku GF7800GTX wsparcie ma charakter

typowo programowy (rekompresja do zgodnego formatu przy użyciu procesora), co

niewątpliwie ma wpływ na wydajność obsługi tego efektu.

Karta referencyjna

(kliknij, aby powiększyć)

GeForce 7800 GTX, którego miałem przyjemność testować występował w postaci karty referencyjnej nVidia, bez żadnych dodatków. Zielony laminat o ponadprzeciętnej długości obsadzono po obu stronach ośmioma modułami Samsung GDDR3 1.6ns, o łącznej pojemności 256MB. Rdzeń graficzny przykrywa duży aluminiowy radiator z wewnętrznym ciepłowodom, do którego przymocowano szereg cienkich blaszek, pomiędzy którymi przepływa strumień powietrza zasysanego przez turbinowy wentylator. Całość nieco przypomina chłodzenie znane z poprzednich modeli GeForce, jednak w odróżnieniu od GF6800Ultra jest zdecydowanie węższe i nie zajmuje dodatkowego złącza na płycie. Na pojedynczym śledziu umieszczono twa gniazda DVI oraz wyjście telewizyjne. W górnej części laminatu znaleźć można gniazdo SLI. Całość waży 415g.

(kliknij, aby powiększyć)

GTX vs 6800 Ultra od Gainwarda (kliknij, aby powiększyć)

Konstrukcję chłodzenia oceniam wysoko. W odróżnieniu od GF6800Ultra w którym wentylator pracował w zakresie pomiędzy (umownie) "głośny" a "huragan", GF7800GTX ogranicza obroty do poziomu, który mógłbym określić jako "średni". Przy tej klasie wydatku energetycznego, można to uznać za wynik bardzo dobry. Oprócz maniakalnych miłośników ciszy, poziom dźwięku jest całkowicie akceptowalny. Co ciekawsze, podczas testów ani razu nie doszło do sytuacji, w której karta zmuszona byłaby do podniesienia obrotów wirnika. W stosunku do poprzednika mamy więc pierwszy sukces funkcjonalny.

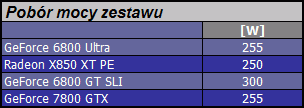

Jakość obrazu bez zarzutu w całym zakresie jaki testowałem (użyłem własnej przejściówki DVI-VGA), czyli do 1600x1200@85Hz włącznie. W czasie intensywnej pracy karta rozgrzewała się do temperatury 60 stopni, oprócz elementów stabilizatora, które osiągały ok. 80 stopni. Pecet testowy (specyfikacja w następnym rozdziale) w "stresie" pobierał z sieci 255W, czyli tyle samo co przy GF6800Ultra i o 5W więcej niż RX850XTPE.

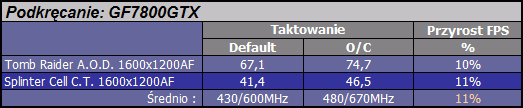

Taktowaną domyślnie 430/600MHz (rdzeń 3D/pamięć) kartę udało się przetaktować do wartości 480/670MHz. Średnia z przykładowych testów w wysokim trybie pomoże określić możliwy do uzyskania wzrost średniego framerate.

Oczywiście dziesięcioprocentowy przyrost nie rzuca na kolana i nie będzie go można łatwo wyczuć w czasie gry. Na koniec dodam, że w czasie pracy na pulpicie systemu (2D) taktowanie rdzenia zmniejsza się do 275MHz.

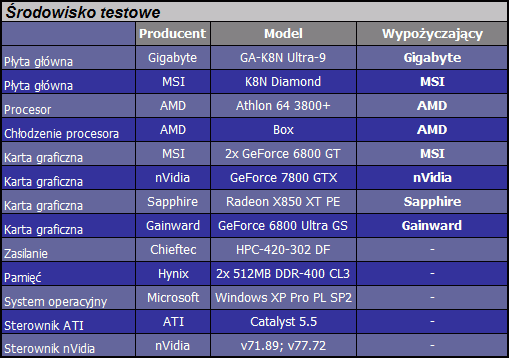

Środowisko testowe

Wyniki testów zbierane były przy wykorzystaniu następującego sprzętu i oprogramowania systemowego:

Wyniki GF6800GT SLI pożyczyłem sobie z zestawu testów, które będą wykorzystane w artykule dotykającym kwestii budowy systemu, opartego na układzie dwóch kart graficznych PCI-Express. Sterowniki pozostawiłem na domyślnych ustawieniach, oprócz wyłączenia VSync. Gry starałem się ustawić tak, aby wymusić najlepszą jakość obrazu. FSAA x4/Anizo x8 włączane były z poziomu gry, a jeśli nie było takiej możliwości, to w sterowniku. W związku z tym, że chciałem ograniczyć wielkość recenzji postanowiłem nie powielać opisów metod testowych. Zainteresowanych odsyłam do poprzednich recenzji. Jedynie w przypadku zmian oprogramowania testowego załączę odpowiednią informację.

Testy

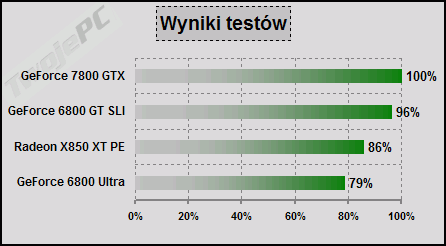

Nadszedł czas aby przemówiły liczby. Komentarze własne starałem się ograniczyć do minimum.

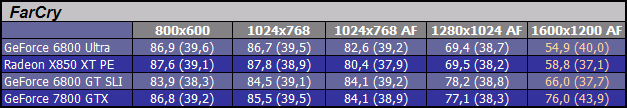

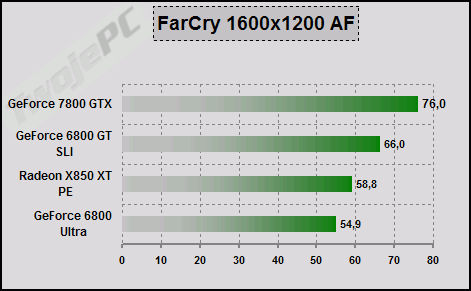

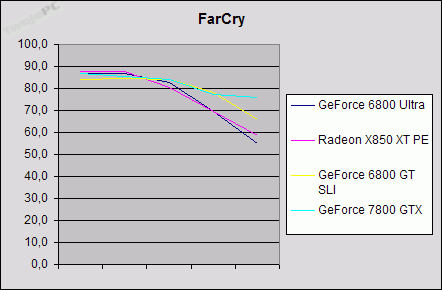

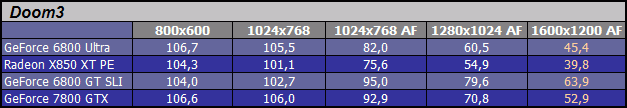

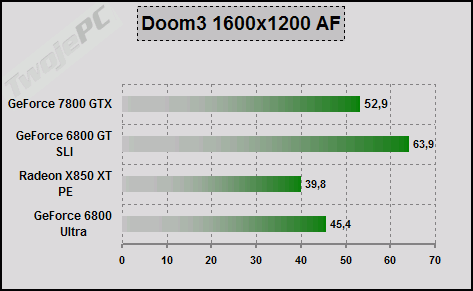

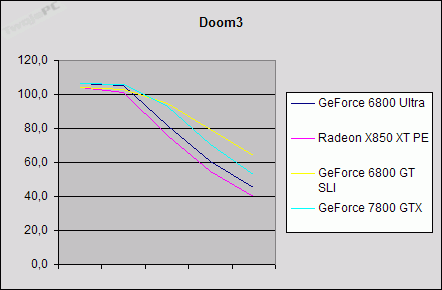

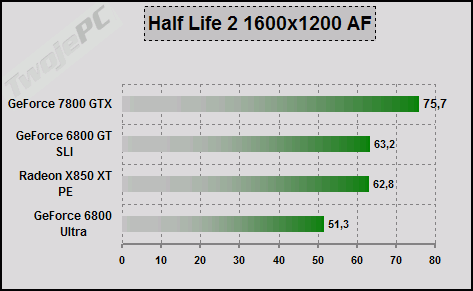

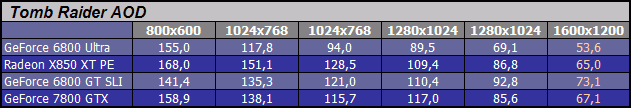

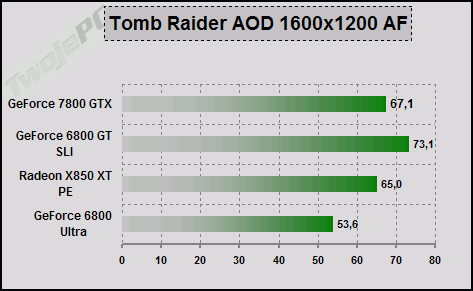

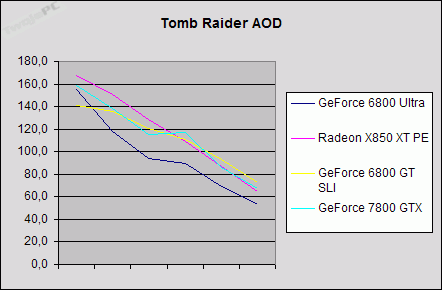

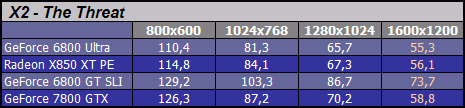

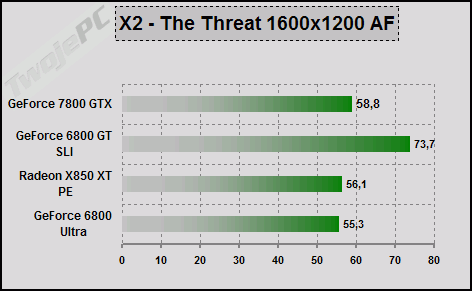

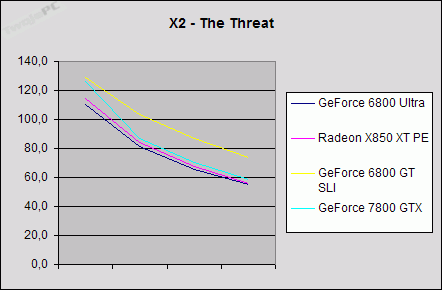

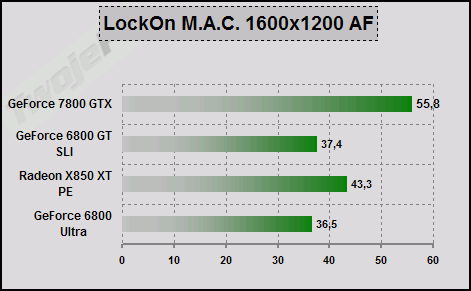

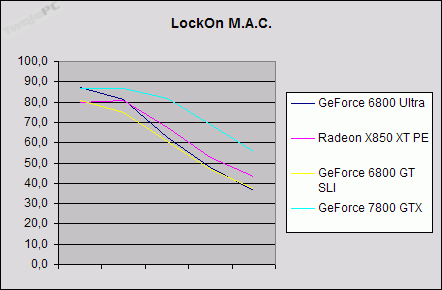

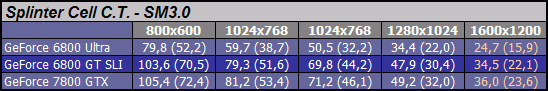

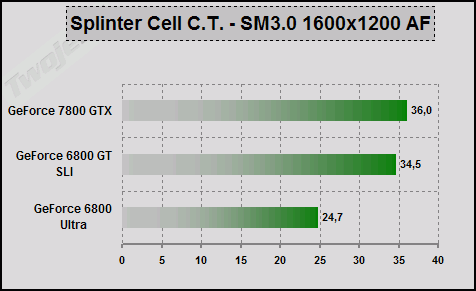

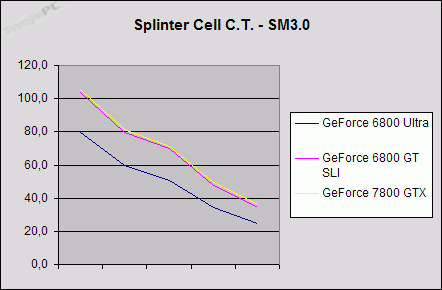

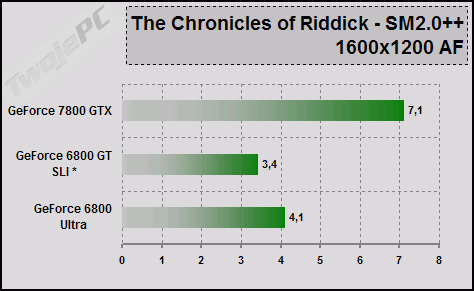

W zasadzie dopiero w 1600x1200 AF coś ciekawego zaczyna się dziać. Konkurencja słabnie a GF7800GTX pokazuje pazury. SLI zawiódł.

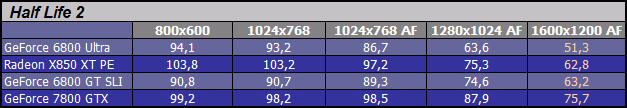

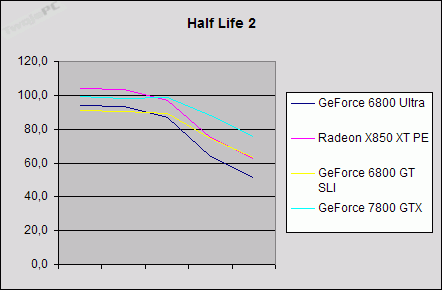

Ta gra znakomicie wykorzystuje możliwości jakie daje połączenie dwóch kart.

GF7800GTX bez problemu rozprawia się z niedawnym królem tej gry.

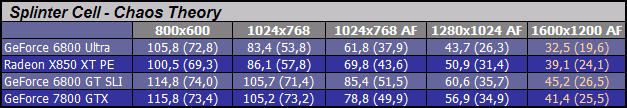

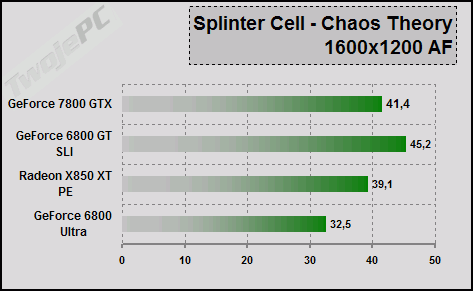

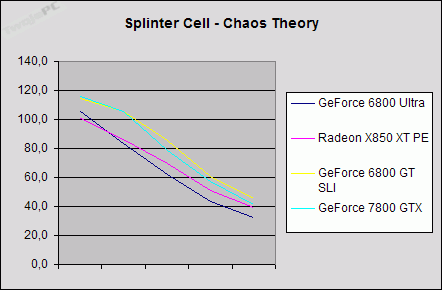

Dotychczas wykorzystywałem starszą wersję Splinter Cell. Wraz z nową generacją kart skończyła się jego przydatność do testów samych kart, bo wynik oparł się na wydajności procesora. Zastąpiła go najnowsza wersja czyli Teoria Chaosu. Do pomiaru wykorzystuję benchmark zawarty w samej grze. Test podstawowy przeprowadzam na ustawieniach SM1.1, aby można było porównać karty oparte na różnych układach graficznych. Zainteresowanych wynikami SM3.0 zapraszam do grupy testów dodatkowych.

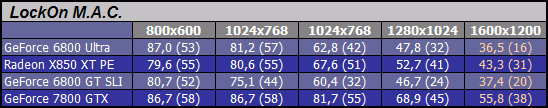

Zaskakująco słabo (na tle konkurencji) wypada GF6800Ultra, jednak pomimo względnie niskiego framerate wszystkie karty radzą sobie nieźle, do 1280x1024 AF włącznie.

W tej grze Radeon jest trudnym przeciwnikiem. No chyba, że mamy SLI.

Wyrównany framerate niezależnie od trybu. Jedynie SLI wyraźnie wybija się na prowadzenie.

Gra wyraźnie nie jest w stanie wykorzystać SLI. GF7800GTX rozprawia się z Radeonem.

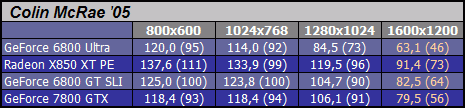

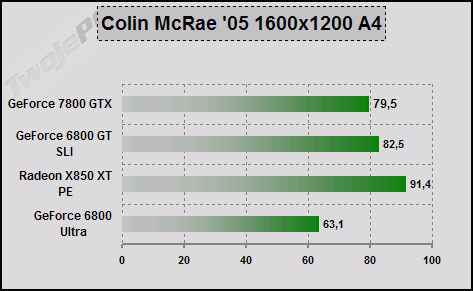

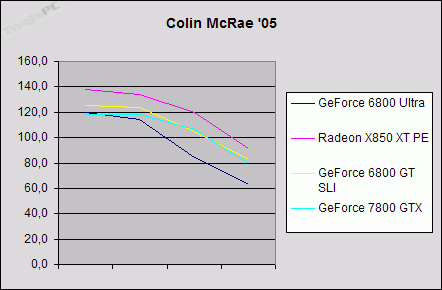

Radeon tym razem nie oddaje koszulki lidera. Muszę również przyznać, że nie samym framerate gra "samochodowa" żyje i w niemal każdej rozdzielczości wyraźnie czuć lepszą odpowiedź karty na układzie ATI, na polecenia przekazywane z klawiatury.

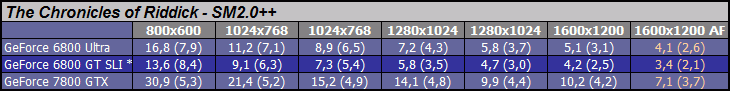

Druga z nowych gier testowych. Do pomiaru używam specjalnego programu testowego ustawionego na najwyższą jakość obrazu i wykorzystującego domyślne demko testowe. Shadery ustawione dla kart SM2.0. Wynik ustawienia SM2.0++ przeniosłem do grupy testów dodatkowych. Miejsce wykonania pomiaru oraz ustawienia są krytyczne i w pozostałych fragmentach gry można liczyć na znacznie wyższy framerate. Warto również przemyśleć zmiany w konfiguracji gry.

Domyślne ustawienia sterownika powodują, że system SLI działa znacznie gorzej niż pojedyncza karta, więc postanowiłem zrobić wyjątek i w tej grze wymusić ustawienie wyłączające tryb dualny. Oczywiście w tej sytuacji nic nie zagrozi GF7800GTX. Najsłabiej wypadł Radeon.

Dodatkowe testy

W przypadku tej recenzji niektóre z dodatkowych testów mogą być pożytecznym źródłem informacji.

Tak jak w przypadku SM1.1 GF7800GTX uplasował się za SLI, tak w SM3.0 sytuacja się odwróciła. Mamy też znacznie większą różnicę w stosunku do GF6800Ultra. To dobrze rokuje na przyszłość. Inna sprawa, że framerate najnowszej karty GeForce również nie zachwyca. W komplecie ustawień SM3.0 jest ten nieszczęsny HDR realizowany przez VS3.0, co przy obecnej architekturze, pomimo poprawek wprowadzonych przez nVidia, wciąż nie zachwyca. Przy tych ustawieniach GF7800GTX umożliwia płynną grę do 1024x768 AF włącznie. Są również fragmenty gry, gdzie framerate jest jeszcze mniejszy.

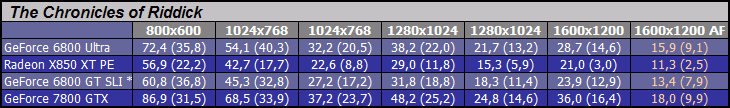

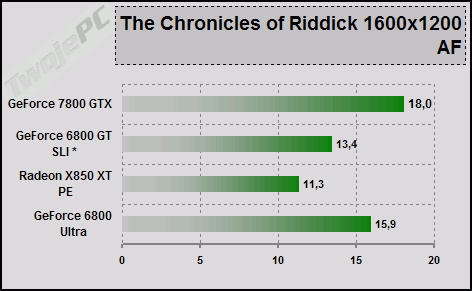

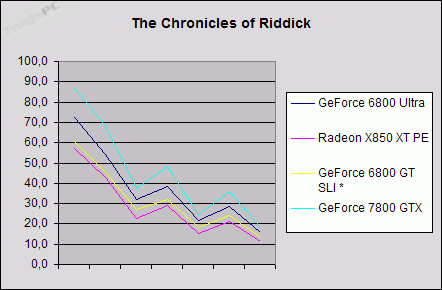

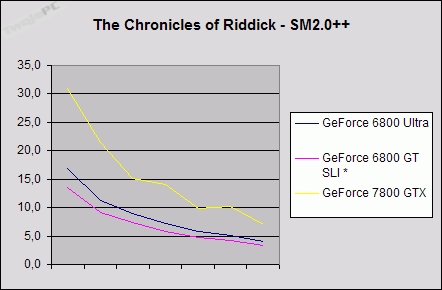

Jeśli ktoś chce zobaczyć GeForce 7800 GTX "na klęczkach" to proszę bardzo. Śliczny pokaz slajdów zafundowany przez programistów Riddick'a. Nie wiem czym zasłużyliśmy, aby nas tak traktować. Inna sprawa, że wyniki są na tyle stabilne, że warto przymknąć oko na kwestię ilości fps, a przyjrzeć się samym różnicom pomiędzy kartami. Mamy kolejną znaczącą przewagę nowej karty. SLI musiałem wyłączyć (podobnie jak w przypadku SM2.0), aby porażka nie była druzgocąca.

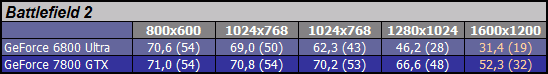

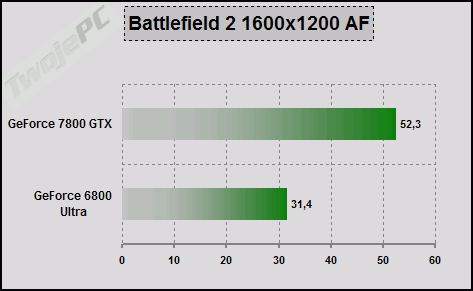

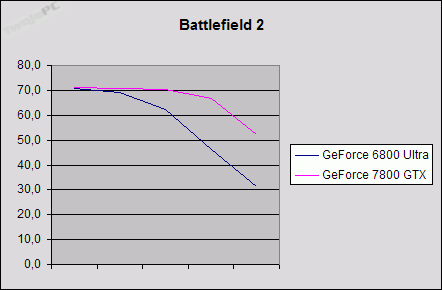

Przymierzam się do wprowadzenia gry Battlefield 2 do grupy testów podstawowych. W związku z tym, że nie mam kompletu wyników dla wszystkich kart biorących udział w porównaniu, dziś zaprezentuję jedynie maleńkie, aczkolwiek chyba interesujące porównanie. Benchmark wykorzystuje nagrane demko uruchamiane skryptem, w czasie którego robię pomiar za pomocą programu Fraps.

Powyżej 1024x768 AF GeForce 6800 Ultra wyraźnie słabnie. W wyższych trybach GeForce 7800 GTX zachowuje się zdecydowanie lepiej. Ten mały teścik stawia nowy układ nVidia w bardzo dobrym świetle.

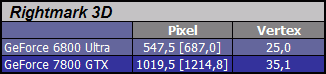

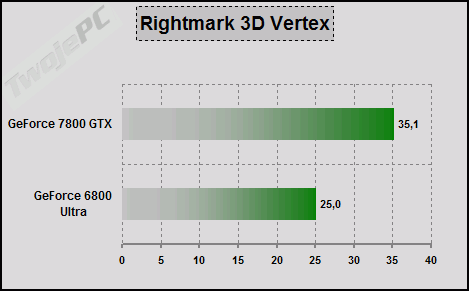

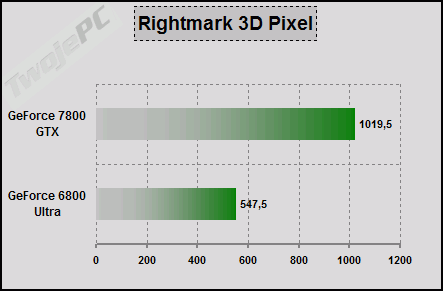

Mały syntetyk bez znaczenia strategicznego. Warto jednak zwrócić uwagę na test cieniowania pikseli. To samo taktowanie, 50% więcej jednostek Pixel Shader, a dwukrotnie wyższy wynik. Można traktować jako potwierdzenie dopieszczenia działania pojedynczego potoku. Podobną sytuację można było zaobserwować w kolejnych modelach GeForce już wcześniej.

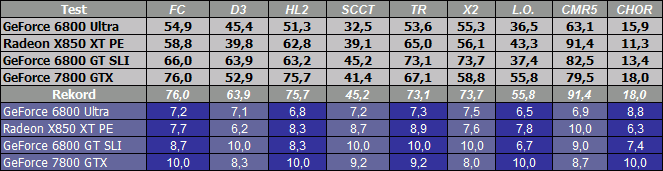

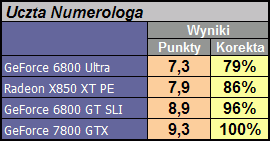

Uczta numerologa

Oczywiście przy takiej ilości wyników trzeba spróbować je jakoś ogarnąć. Podobnie jak w poprzednich recenzjach, wyniki z najwyższego trybu (kwestia odpowiedniego dociążenia układu graficznego tych "potworów") przeliczam na skalę procentową (licząc od zera do 100% dla zwycięzcy), aby wyciągnąć średnie różnice pomiędzy kartami.

Szczerze mówiąc do końca nie wiedziałem czy GF7800GTX "przeskoczy" tandem 2xGF6800GT w łącznej klasyfikacji. A jednak udało mu się tego dokonać. Inna sprawa, że w Riddick SLI dostał ode mnie przywilej modyfikacji sterowników czego normalnie nie robię.

Być może niektórzy są zawiedzeni wielkością różnic pomiędzy GF6800Ultra a GF7800GTX. Przypominam, że są to wyniki uśrednione. 20% jest bardzo konkretną przewagą. Co ważniejsze dużo wskazuje na to, że w przyszłości, wraz z pojawianiem się nowych gier będzie ona rosła. Należy również pamiętać jak mocne są te karty. W wielu przypadkach nawet tak ekstremalne tryby oraz potężne wsparcie procesora nie zmuszają układów do maksymalnego wysiłku.

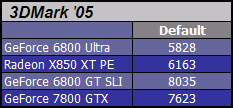

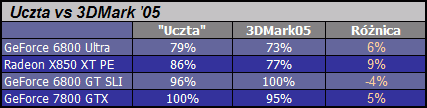

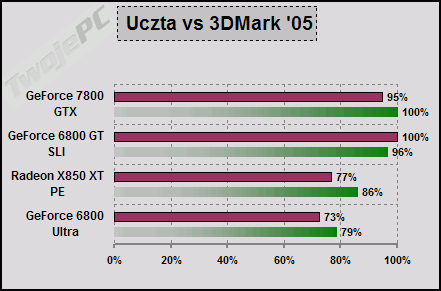

Skoro jest to uczta numerologa to nałogowiec pewnie czuje się niedopieszczony brakiem swojego ulubionego 3DMark'a. Specjalnie dla niego dodatkowe porównanie mojej klasyfikacji kart z wynikami tego benchmarka.

W zasadzie specjalnie dużych różnic się nie dopatrzymy. Jako, że test jest dobrze dostosowany do SLI to oczywiście będzie to preferowane rozwiązanie. Największa różnica (9%) występuje przy Radeonie. Prawdopodobnie wynika to z faktu braku FSAA/Anizo w domyślnym teście 3DMarka, co nieco osłabia pozycję karty ATI.

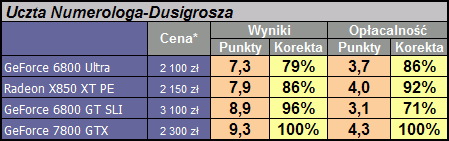

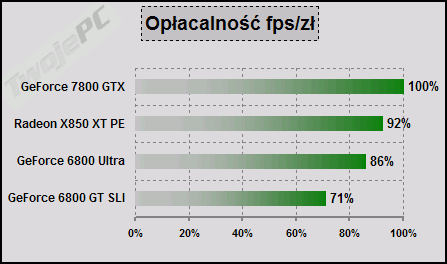

Na koniec próba określenia "opłacalności" zakupu danej karty biorąc pod uwagę jej cenę rynkową i zdolność do osiągania konkretnego framerate. Do tego wykresu należy podchodzić ze sporą dozą tolerancji ponieważ ceny nie są stabilne i można się liczyć z możliwością znaczących obniżek starszych kart. GF7800GTX jest na rynku nowością i wobec braku podaży również i jego ceny mogą mieć znaczne wahania. Każdy może przeliczyć te wartości dla takich cen, jakie są mu dostępne. Ja starałem się wybrać najniższe, spośród oferty kilku sklepów internetowych.

W związku z tym, że GF7800GTX "wystartował" (przynajmniej w cennikach) na poziomie niewiele wyższym od ceny kart poprzedniej generacji, to oczywiście znalazł się na czele stawki "opłacalności". Nikogo nie powinna chyba dziwić słaba pozycja SLI pomimo, że brałem jedynie cenę dwóch "gołych" kart, a mógłbym również uwzględnić koszt mocniejszego zasilacza i płyty wyposażonej w dwa gniazda PCI-Express x16. Tą tabelę można również interpretować w innym kierunku. Jeśli nie nastąpią obniżki cen np. Radeonów X850XTPE, to nowe karty nawet kosztując 2500 zł miałyby pokrycie ceny we wzroście średniego framerate lub z drugiej strony, jeśli cena GF7800GTX utrzymałaby się na tym poziomie, to ten sam Radeon powinien kosztować poniżej 2000 zł (proszę pamiętać, że chodzi o wersję Platinium). Takie są uroki premier sprzętowych.

Podsumowanie

GeForce 7800 GTX, którego miałem przyjemność gościć przez kilka dni, wywarł bardzo korzystne wrażenie. Nie ma najmniejszych wątpliwości, że jest to aktualnie najmocniejsza karta graficzna na rynku. Brak pełnej kompatybilności rozwiązania SLI powoduje, że (średnio licząc) nawet tandem dwóch GF6800GT dysponujących łącznie 32-ma potokami pikseli może okazać się słabszym rozwiązaniem, nie wspominając o cenie czy innych walorach użytkowych takiego systemu. Zresztą nic oczywiście nie stoi na przeszkodzie, aby bogaty miłośnik ekstremalnych osiągów nie wykorzystał do SLI dwóch GTX'ów.

Wbrew wcześniejszym obawom, dzięki przejściu na technologię 0.11um i optymalizacji architektury wewnętrznej, rozbudowa jednostek obliczeniowych rdzenia nie pociągnęła za sobą zwiększenia zużycia energii, a przemyślany układ chłodzenia trzyma w ryzach zarówno temperaturę jak i hałas wentylatora.

Rdzeń G70 nie mogę uznać za jakąś rewolucję. Jest dobrze przemyślanym rozwinięciem serii NV4x. Dodatkowe quad'y i drobne poprawki w samych jednostkach obliczeniowych, pomimo pozostawienia 16 ROP'ów i braku zmian w architekturze pamięci, pozwoliło wznieść się na znacznie wyższy poziom wydajności. Podobnie zresztą jeszcze niedawno postąpiła firma ATI przy projektowaniu serii X800. I z równie dobrym rezultatem.

Tu jednak nie mogę powstrzymać się przed drobną dygresją. Być może entuzjaści nowych technologii są nieco zawiedzeni brakiem istotnych zmian w zakresie możliwości tworzenia efektów 3D, ale proszę dać możliwość wykazać się programistom gier. Może w końcu przynajmniej uda się wykorzystać w pełni możliwości, jakie daje Dx9. Zamiast wartościowej optymalizacji kodu silniki gier próbują w jak najkrótszym czasie przystosować się do nowych możliwości hardware, pojawiają się jakieś pokraczne produkty z bijącym po oczach konsolowym rodowodem, a za to z wprowadzonymi nie wiadomo po co efektami, które przy drobnych różnicach w obrazie mordują płynność. Rozumiem, że twórcy układów graficznych potrzebują pożywki marketingowej, ale chciałbym aby przynajmniej niektóre z efektów były jedynie opcjonalnym dodatkiem, a nie głównym, choć niestrawnym daniem nowej gry. Dlaczego łatki do gier czy konieczność ładowania coraz to nowych sterowników staje się niezbędnym składnikiem życia miłośników gier? Czy tylko ja mam wrażenie, że nagminne przekładanie premier, przynajmniej niektórych tytułów gier, ma związek z pionami marketingu producentów hardware i koniecznością dostosowania się do kolejnych "generacji" ich pupilków? Oczywiście (i na szczęście), że wśród powodzi takich niedopieszczonych produkcji znajdą się i perełki, na które każdy gracz mógłby się powołać, ale ja osobiście czuję pewien niedosyt. Tyle dygresji.

Zanim zaczniemy rozważać możliwości pojawienia się słabszych bądź silniejszych mutacji kart GeForce 7800 GTX, kwestię dostosowania do złącza AGP, analizować nigdy nie milknące spory miłośników kart dwóch czołowych producentów układów graficznych czy próbować rozpatrywać treść plotek na temat nowych rdzeni graficznych ATI, proponuję skoncentrować się na tym, co już jest w zasięgu ręki.

Na rynku pojawił się nowy lider wydajności. Karta zachowuje się jak typowy GeForce serii 6 na sterydach. Pojawiła się w cenie niższej, niż przy poprzednich premierach najwyższego segmentu i zbliżonej do cen topowych produktów poprzedniej generacji. Wszystko wskazuje na to, że powinno się to odbić serią obniżek poprzednich modeli i to w większości klas cenowych (a szczególnie wśród 16-stopotokowców), co powinno być dobrze odebrane przez mniej zasobnych w gotówkę graczy. Problemy ze sterownikami pozostają na poziomie znanym z serii 6. W zasadzie to SLI wydaje się aktualnie największym źródłem kłopotów ze strony użytkowników i jeśli posiadacz takiego rozwiązania czuje się wystarczająco usatysfakcjonowany wydajnością, a nie odpowiadają mu inne kwestie związane z funkcjonalnością tandemu kart może w końcu przemyśleć powrót do "singla". Może również, przy zachowaniu całej infrastruktury sprzętowej wymienić obie karty, wzbijając się na kolejny poziom mocy. Są przecież tacy, którzy zawsze muszą być na najwyższym szczeblu drabiny sprzętowej i stać ich na to. Nie ma dla nich znaczenia, że 3DMark to tylko test, a ustawienia niektórych gier na najwyższą jakość obrazu są bardziej "spowalniaczem" niż "polepszaczem" czegokolwiek. To po prostu taka forma sportu dla wybranych, a frajda ma przecież różne oblicza.

Niezależnie czy potraktujemy nowy układ jako przyczynek do szeregu obniżek, nowego rekordzistę testów, biczyk na miłośników konkurencyjnych produktów, czy propozycję budowy peceta przygotowanego na nadejście nowej generacji gier, premiera GeForce 7800 GTX, bez cienia wątpliwości, jest dla mnie sukcesem. Mimo, że należę do grupy osób, które nie gustują w produktach z najwyższej półki cenowej (nawet jeśli stać mnie na nie), to nowa karta zrobiła na mnie dobre wrażenie i mogę ją spokojnie polecić każdemu, kto szuka rozwiązań sprzętowych w tym zakresie mocy 3D. Produkt zasługuje na wyróżnienie choć proszę pamiętać, że jest to referencyjna karta nVidia i dopiero porównanie wyposażenia i funkcjonalności gotowych produktów sklepowych powinno skierować uwagę nabywcy na konkretny model.

GeForce 7800 GTX

|

Jako, że nie wygląda na to, aby była to jedyna premiera sprzętowa topowego produktu 3D zaprezentowanego tego lata, to pozwolę sobie zakończyć ten artykulik pewnym ... takim ... niedomówieniem ...

Sprzęt do testów dostarczyły firmy: Sprzęt do testów dostarczyły firmy:

|

|  | Multimedia Vision |

|  | GIGABYTE Polska |

|  | MSI Polska |

|  | AMD Polska |

|  | Sapphire, Inc. |

|  | NVIDIA |

|