|

TwojePC.pl © 2001 - 2024

|

|

S P R Z Ę T |

|

| |

|

Gainward GeForce3 PowerPack !!! "Golden Sample" Gainward GeForce3 PowerPack !!! "Golden Sample"

Autor: Kris

Data: 08/10/01

|

|

|

Dzięki uprzejmości firmy Multimedia Vision miałem możliwość dokładnego przyjrzenia się karcie opartej na układzie nVidia GeForce3 wyprodukowanej przez firmę Gainward. Opiszę konkretne rozwiązanie Gainwarda, ale również postaram się podsumować możliwości samego układu graficznego. Układ GeForce3 już zdążył zadomowić się na naszym rynku. Mamy do wyboru kilka modeli przygotowanych przez większość firm produkujących karty oparte na układach nVidia. Z uwagi na możliwości i co niestety za tym idzie, również cenę można je uznać za sprzęt elitarny, dostępny dla wąskiego kręgu odbiorców, dysponujących większym zapleczem finansowym. Możliwości współczesnego komputera przeznaczonego do gier w zasadniczym stopniu opierają się na funkcjonalności karty graficznej. To na niej spoczywa główne zadanie związane z tworzeniem obrazu trójwymiarowego. Oczywiście karcie należy zapewnić odpowiednie warunki pracy. Pozostałe elementy komputera powinny być tak dobrane, aby inwestycja miała sens. Karty GeForce3 były już wielokrotnie testowane i w zasadzie wiadomo, jaka siła w nich drzemie. W niniejszym artykule zawarłem kilka informacji o możliwościach wejścia wizyjnego, nowych Detonatorach oraz spróbowałem rozjaśnić kilka aspektów związanych z szeroko rozumianą wydajnością. Więcej w nim będzie uwag ogólnych, dygresji i opisów funkcjonalnych a miłośnicy porównań fps i mnogości tabelek będą, delikatnie mówiąc, rozczarowani.

|

Gainward

Firma Gainward już od dłuższego czasu oferuje produkty graficzne. Jeszcze niedawno ich karty zaliczaliśmy do klasy podstawowej i ustawialiśmy w klasyfikacji zaraz po wschodnich "beznazwowcach". Podobnie z resztą było z Leadtekiem, Microstarem czy Prolinkiem. Co się zmieniło od tego czasu? Sporo. Znikło z rynku kilka bardziej egzotycznych producentów natomiast Ci, którzy się utrzymali przebudowali strategie marketingową. Najnowsze układy graficzne są na tyle drogie, że przestało być opłacalne siłowe zmniejszanie kosztów produkcji poprzez stosowanie gorszych podzespołów. Rynek zareagował na tyle pozytywnie, że wiodący dotychczas producenci zmuszeni zostali do obniżenia cen swoich produktów, aby sprostać nowej konkurencji. Uogólniając poziom jakości kart zdecydowanie się wyrównał. Oczywiście tylko te największe firmy są w stanie zaoferować klientom własne modyfikacje sprzętowe kart bazowych producenta chipów lub wprowadzić nowe elementy do referencyjnych sterowników. Jednak z punktu widzenia kupującego ważne jest to, aby karty nie traciły funkcjonalności czy jakości względem specyfikacji. Gainward zadziwił świat wydaniem ekskluzywnej wersji MX'a, którym przebił się do czołówki najlepszych kart na rynku. Dziś przedstawię najdroższą z dostępnych kart tego producenta czyli Gainward GeForce3 PowerPack !!! "Golden Sample". Nazwa może się komuś wydawać dosyć krzykliwa, ale właśnie poprzez odnośnik do uznanego już MX'a możemy liczyć na wysoki standard.

Sprzęt

W pudełku znajdziemy oprócz samej karty, instrukcję w języku angielskim, 2x CD z driverami, dodatkami i oprogramowaniem narzędziowym, WinDVD, Ulead VideoStudio oraz kabelek zapewniający wejścia i wyjścia video. Sama karta jest bardzo bogato wyposażona w dodatki sprzętowe. Oprócz wyjścia analogowego VGA na monitor CRT mamy również wyjście cyfrowe DVI do podłączenia monitorów LCD (tych, które wyposażone są w takie wejście) oraz zespolone gniazdo video, w które wkładamy specjalny kabelek rozgałęziający. Daje on zestaw wyjść i wejść video, z którego każdy występuje zarówno w standardzie composite (sygnał zespolony) jak i s-video (rozdzielona chrominancja i luminancja). Takiej ilości wyprowadzeń nie ma żadna znana mi karta GF3. Asus i MSI mają również wejście video (Asus również dodaje okulary 3D) a Herkules i Leadtek wyjście DVI, ale wszystko razem "sklepał" jedynie Gainward.

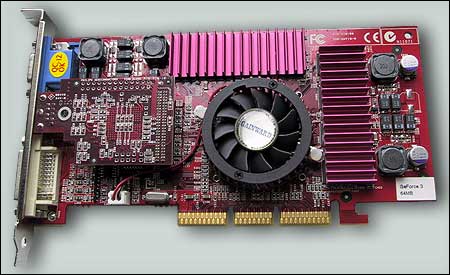

Zgodnie z najnowszą modą na malowanie płytek karta ma kolor czerwony. Układ odpowiedzialny za wejście i wyjście video wraz z gniazdem umieszczony jest na małej dodatkowej płytce połączonej specjalnym gniazdem. Chip graficzny chłodzony jest orbopodobnym wentylatorkiem a na pamięci naklejono radiatorki. Karta jest oczywiście przystosowana do AGP x4 a całością zarządza BIOS w wersji 3.20.00.10.00. Rdzeń pracuje na 200MHz a pamięci taktowane są zegarem 230MHz DDR (460MHz), czyli zgodnie ze specyfikacją NVidia. Informację handlową producenta znajdziemy na stronie: www.gainward.com

Oprogramowanie

Na dołączony płytach znajdziemy komplet oprogramowania pozwalający na ożywienie karty. Oprócz driverów (opartych na Detonatorach 3 v12.41) Gainward serwuje "uładniacz" o nazwie Exper Tool (wersja 2.73). Instalacja przebiega bezproblemowo. Przed zainstalowaniem drivera Gainward pyta nas czy chcemy domyślną czy zwiększoną wydajność. Śmieszne pytanie. Oczywiście zwiększoną!

Ciekawe pytanie przy instalacji... (wersja duża po kliknięciu)

...i ciąg dalszy tego procesu (wersja duża po kliknięciu)

Po chwili karta jest gotowa do pracy. "Zwiększona wydajność" jest niczym innym jak zmianą domyślnego taktowania karty na poziomie sterowników. Zamiast 200/460MHz (rdzeń/pamięć) uzyskujemy 220/480MHz. Nie jest to specjalnie duża zmiana, ale w ten sposób karta uzyskuje minimalnie lepsze wyniki w testach niż domyślnie taktowane karty konkurencji. Dla nałogowego podkręcacza jest to raczej śmieszna opcja ("ręcznie" można uzyskać więcej), ale warto zdać sobie sprawę z tego, że producent nie tylko nie ma nic przeciw nadtaktowaniu karty, ale sam nas do tego zachęca uznając możliwości własnego produktu powyżej oczekiwań referencyjnych.

Exper Tools (wersje duże po kliknięciu)

Exper Tool to dodatkowy programik integrujący się z referencyjnymi driverami, umożliwiający szybszy dostęp do kilku podstawowych parametrów karty. Muszę przyznać, że zarówno typowa dla Tajwanu szata graficzna jak i realny brak jakichkolwiek ważnych usprawnień ponad to, co przewidział producent driverów, nie skłoniło mnie do wykorzystania Exper Toolsa i bez żalu go odinstalowałem. Zawsze dobrym pomysłem na tym etapie instalacji jest sprawdzenie na Internetowej stronie producenta czy nie ma nowszych wersji oprogramowania lub biosów.

Producent zamieścił jedynie nieco nowszą wersję driverów v14.10 i jako, że z www.nvidia.com ściągnąłem najnowsze Detonatory 4 (zwane XP, wersja 21.81) sens stosowania softu Gainwarda nie był najlepszym pomysłem. Ciekawszą okazała się za to strona z biosami do kart graficznych. Okazuje się, że możemy wymusić taktowanie 220/480MHz już w momencie startu karty. Dobrze świadczy to o sprzęcie, choć sens wymiany biosa jest dla mnie wątpliwy (niepotrzebny stres dla mniej zorientowanych przy flashowaniu, a zysk w sumie niewielki). Jeśli ktoś zamierza wykorzystywać wejście video to warto również sprawdzić czy nie ma nowszych wersji sterowników do jego obsługi.

InterVideo WinDVD OEM

W zasadzie producent dołączył do karty dwa programy "płatne". Pierwszym z nich jest programowy odtwarzacz InterVideo WinDVD OEM z nieznacznie zmodyfikowaną dla Gainwarda "skórką". Oprogramowanie jest w wersji 2.6 i umożliwia wykorzystanie sprzętowej kompensacji ruchu układu GeForce3. Jest to jeden z trzech głównych produktów do odtwarzania filmów DVD i w zasadzie chyba nie wymaga specjalnej rekomendacji. Moim zdaniem przy kartach w tej klasie cenowej powinno się go traktować jako standard a jego brak po prostu dyskredytuje producenta. Aby wykorzystać możliwości wejścia video i obrobić uzyskany w ten sposób materiał filmowy (np. nagrany z kamery lub magnetowidu) mamy do dyspozycji Ulead VideoStudio 5.0 SE.

Ulead VideoStudio 5.0 SE

Nie jest to produkt równie zaawansowany jak Adobe Premiere czy nawet Ulead MediaStudio, ale moim zdaniem w zupełności wystarcza do domowej zabawy w edycję prostych filmów z ujęć zgranych z kamery. Ma do tego niezaprzeczalne zalety, jakimi są prostota obsługi oraz szybkość montażu. To samo oprogramowanie znajdziemy w pudełkach Asus DeLuxe oraz ATI Radeon VIVO. W sumie, oprogramowanie Gainwarda oceniam pozytywnie, choć w tej klasie (i cenie) chciałbym zobaczyć dodatkowo przynajmniej jedną grę.

Obraz 2D

Jakość obrazu w Windows przyjemnie zaskakuje. Karta generuje ostry i dosyć nasycony obraz umożliwiający wygodną pracę do 1600x1200 @ 85Hz włącznie. W stosunku do najlepszych kart konkurencji nie tracimy w zasadzie nic. Duża szybkość i niezłe kolory. Nie mogę powiedzieć, że karty np. Asusa zaoferują lepszy standard, choć w przypadku takich firm mamy większe możliwości dostrojenia parametrów obrazu dzięki zmodyfikowanym sterownikom (oczywiście możemy użyć dodatkowego oprogramowania, aby osiągnąć ten sam efekt na Gainwardzie). Jak dla mnie ATI daje wciąż minimalnie lepszy obraz ale to już raczej zakrawa na czepialstwo z mojej strony. Po lekkiej zmienie temperatury barw od strony monitora mam wrażenie jedynie minimalnie mniejszego nasycenia i gorszej bieli. Podsumowując, kartę Gainwarda mogę śmiało zarekomendować nawet do najlepszych monitorów.

Nadtaktowanie

Karta nie miała najmniejszych problemów z wyświetlaniem obrazu do 240/540MHz włącznie. Z małym przymrużeniem oka nawet do 240/550MHz (rdzeń/pamięć). Przy rdzeniu 250MHz po stosunkowo krótkim czasie następował zwis natomiast przy pamięciach 560MHz "śnieg" padał już na pulpicie Windows. Przy pamięciach 550MHz po dobrym wygrzaniu można zobaczyć już tylko kilka drobnych zakłóceń w nielicznych momentach (np. początek dema Dragothic High Detail z 3DMark2001) na ciemnym tle. W stosunku do "firmowego" podkręcania 220/480MHz różnica jest już spora, tym bardziej, że taktowanie pamięci ma większy wpływ na wydajność karty. Muszę przyznać, że jak na kawałek dwustronnej taśmy termoprzewodzącej, która łączy radiator z układem wynik podkręcania rdzenia jest zupełnie przyzwoity. Nie odnotowałem problemów z podkręconą do 100MHz szyną AGP.

Detonatory XP (4)

Na początku drugiego tygodnia września nVidia udostępniła dla posiadaczy kart opartych na ich układach nowe drivery referencyjne, które nazwano zgodnie z aktualną modą Detonatorami XP (wpływ marketingu Microsofta, promującego nowy system jest niemal paraliżujący). Wcześniej zapowiadane były jako Detonator 4 i przyzwyczaiłem się do tej (nieoficjalnej) nazwy. Dla kogo tak naprawdę są te nowe drivery? Chyba niechętnie muszę przyznać, że dla wszystkich, choć zysk wydajności zarezerwowany jest jedynie dla posiadaczy kart GeForce3. Od dłuższego czasu jestem zwolennikiem wymiany driverów na nowsze referencyjne, bo w dłuższym okresie czasu potrafiło okazać się, że jest to niezbędne z powodu przystosowania oprogramowania. Producenci gier wykorzystują przy tworzeniu nowych lub poprawianiu starszych silników właśnie aktualne sterowniki i w zasadzie nie interesuje ich zgodność z poprzednimi. Przejście na nowe drivery nie jest koniecznością chwili dla posiadaczy starszych kart, ale należy się z tym liczyć. Natomiast posiadacze kart GeForce3 nie mają takich dylematów. Odpowiedź jest prosta. Ściągać i używać. Oczywiście informacje nVidia o możliwości uzyskania do 50% poprawy wydajności są mocno naciągane, ale w wyniku przeprowadzonych testów mogę potwierdzić ok. 20-procentowy wzrost wyników pomiaru średnich fps w demach gier 3D w trybie 1600x1200x32. Jest to naprawdę przyzwoite przyspieszenie i można je w tym trybie odczuć realnie w wielu grach. Oczywiście sterowniki lepiej dopalają kartę w każdym trybie, ale w niższych trudno liczyć na duże zwiększenie wyników pomiarów gdyż wpływ wydajności samej karty maleje. Skąd bierze się takie przyspieszenie? Czy nVidia hamuje własne układy zachowując asy w rękawie jako tajna broń przeciw konkurencji? Nie sądzę. GeForce3 podobnie jak i jego poprzednicy zawiera rdzeń architektury wyprowadzony bezpośrednio z TnT co powoduje znaczne ułatwienie adaptacji sterowników do nowego produktu. Jednocześnie nowy układ wyposaża się w szereg nowych możliwości, z których część ma bezpośredni wpływ na wydajność (np. nowy kontroler pamięci). Optymalne oprogramowanie poprawionych fragmentów architektury musi trwać a szybkość wdrożenia produktu przy naciskach konkurencji potrafi uniemożliwić synchronizację tych elementów. Stąd też nVidia zawsze ma poślizg w wydaniu driverów, które w istotny sposób wpływają na nowe karty i dlatego też głównie one są w stanie coś na nich zyskać. Natomiast termin ich wydania wydaje się spowodowany dosyć nerwowymi ruchami po wstępnych testach nowych kart ATI Radeon 8500, które stanowić mają ich bezpośrednią konkurencję. Moim zdaniem te sterowniki nie są jeszcze na tyle dopracowane, aby sens miało przyspieszanie ich wydania i spodziewam się w niedługim czasie aktualizacji. Do tego czasu posiadacze starszych kart mogą spokojnie odpuścić nowe sterowniki. Detonatory XP (4) można ściągnąć ze strony: www.nvidia.com

VIVO

Gainward GeForce3 VIVO wyposażono w układ Philips SAA7108E. Układ ten jest klasycznym silnikiem wyprowadzeń telewizyjnych wszystkich kart VIVO opartych na GeForce3. Ten sam układ zastosował również Asus i MSI. Zapewnia on jednocześnie zarówno kodowanie (TV-out) jak i dekodowanie (TV-in) sygnału wizyjnego. Zintegrowanie tego w jednym układzie umożliwia zyskanie funkcjonalności względnie tanim kosztem. ATI stosuje aktualnie w swoich kartach VIVO układ ATI Theater, który realizuje to samo zadanie. Niestety muszę przyznać, że implementacja Gainwarda a w zasadzie nVidii rozczarowała mnie. Zaczęło się od walki z uzyskaniem obrazu na telewizorze przy użyciu oryginalnych driverów. Na szczęście zamiast szukać siłowo rozwiązania problemu odpuściłem temat a nowe Detonatory poradziły sobie z zadaniem. Generowany na telewizorze obraz nie odbiega od standardów układów wyjścia BT86x czy Chrontela. Zbliżona jakość i dostępne tryby. Opcja zdaje egzamin przy oglądaniu filmów oraz w grach. Oczywiście do pracy z pulpitem Windows telewizor się nie nadaje. Spore zastrzeżenia budzi natomiast kwestia ergonomii działania, jeśli porównamy z innymi kartami. Niestety nVidia nie wyposażyła GeForce3 w "dualne" możliwości MX'a ale co równie ważne Philips jako układ wyjścia pozbawiony jest wsparcia ze strony zewnętrznego oprogramowania. Nie możemy wykorzystać znakomitego TVTool (TVCC), dzięki któremu można uzyskać jednoczesne wyświetlanie na monitorze (większość nie radzi sobie z odchylaniem 50Hz) czy overscan. Pozostaje jedynie bardzo ograniczony support ze strony samych sterowników. Tak jak w przypadku wyjścia można mówić jedynie o pewnych utrudnieniach funkcjonalnych tak kwestia wejścia wzbudziła u mnie niejaki niesmak. Jestem przyzwyczajony to pewnego standardu działania z analogowym capture. Generalnie ściągam z kamery ujęcia kodując w locie do mjpeg (avi) w standardzie PAL (704x576 25 fps), edytuje i na koniec koduję off-line gotowy materiał w mpeg1/2/4/divx. VirtualDub prawidłowo podłączył się do drivera WDM i teoretycznie umożliwił capture do 720x480. Umożliwił to dobre słowo, bo niezależnie od trybu zawsze gubiłem sporą część ramek. Nawet najmniejsze rozdzielczości obarczone były tym problemem. Muszę przyznać, że nie potrafię wytłumaczyć takiego zachowania karty. Próbowałem różnych platform sprzętowych, oprogramowania i sterowników. Zawsze ten sam efekt. Przez całkowitą klapą ratuje Gainwarda Ulead VideoStudio a w zasadzie zintegrowany z nim online'owy kodek mpeg1/2 LSX firmy Ligos. Niestety edycja materiału filmowego w postaci mpeg trwa koszmarnie długo a jakość obrazu kodowanego LSX'em odbiega klasą od dobrych koderów off-line, ale przynajmniej można jakoś wykorzystać funkcjonalność VIVO. Wprawdzie i w tym formacie niektóre ramki zostały pominięte, ale w niższych trybach przestaje to doskwierać. Ba. To jeszcze nie koniec problemów. W czasie capture należy się liczyć z kłopotami związanymi z synchronizacją dźwięku, który często nie nadążał za obrazem. Szczerze mówiąc, jeśli wymagamy funkcji VIVO to sugeruję szukać rozwiązania wśród kart ATI albo dokupić oddzielną kartę capture do wersji GeForce3 z samym TV-out (np. Gainwarda), co wpłynie również na poprawę obsługi wyjścia. Jedyne, do czego ewentualnie nadaje się w tym względzie ta karta to tworzenie małych filmików na potrzeby internetowe. Również muszę rozczarować miłośników videokonferencji bo mimo zastosowanie wszelkich swoich sztuczek z wrapperami VFW nie udało mi się zmusić NetMeetinga do wyświetlenia obrazu.

Możliwości graficzne

Jeśli jeszcze ktoś ma wątpliwości to z przyjemnością potwierdzę: GeForce3 to najmocniejsza karta graficzna do gier, jaką aktualnie jesteśmy w stanie kupić. Przynajmniej do momentu, w którym pojawią się GF3 Ti/500 i ATI Radeon 8500. Zanim jednak powiem parę słów na temat tego jak można tą moc wykorzystać najpierw spróbuję rozjaśnić nieco spraw związanych z tzw. "wydajnością w grach". Mnogość wszelakich testów i porównań powoduje u wielu niezły mętlik. Niektórzy wręcz przestają widzieć to, co najważniejsze. Akcelerator 3D powstał, aby w grach można było przedstawić świat bliższy temu, który oglądają nasze oczy. Miarą możliwości karty do gier nie jest średnia ilość fps, z jaką renderowany jest konkretny fragmentu grafiki 3D, ale maksymalna jakość obrazu, z jaką ta karta może płynnie wygenerować ten fragment. Problem w tym, że tak naprawdę zarówno jakość obrazu jak i płynność renderingu mają charakter bardzo subiektywny i co ważniejsze w zasadzie niemierzalny. Tysiące porównań fps wywołuje już u niektórych zupełnie mylny obraz sytuacji. Coraz częściej słyszę zupełnie moim zdaniem bezsensowne stwierdzenie, że jakaś karta jest "szybsza" w grach. Co to ma oznaczać? Że nasz wirtualny samochód pojedzie w symulacji szybciej? Bzdura. Jeśli w danym trybie i ustawieniach mamy problemy z płynnością trzeba po prostu zmniejszyć jakość obrazu poprzez zmianę rozdzielczości, ilości kolorów czy poziomu szczegółów. Upraszczając mocno zagadnienie: jakość obrazu przy zachowaniu satysfakcjonującego nas poziomu płynności wprost zależy od klasy naszego akceleratora. Może dam prosty przykład pułapek pomiaru możliwości kart średnimi fpsami. Z góry przepraszam za znaczne uproszczenia rozumowania, ale chcę aby było to bardziej zrozumiałe. Wyobraźmy sobie dwa silne akceleratory, które przechodzą test w demie jakiejś gry. W 1280x1024 jedna renderuje ze średnią ilością fps o 20% większą niż druga a w 1600x1200 o 50%. Co nam to mówi oprócz tego, że ta pierwsza ma większą wydajność? W zasadzie niewiele. Nie jesteśmy w stanie stwierdzić o ile jest lepsza a co za tym idzie czy w przypadku różnych cen wydatek jest opłacalny. Dlaczego? Nie znamy przynajmniej dwóch czynników. Nie wiemy czy w danym trybie tracimy płynność ani nie wiemy, jaka jest realna różnica obrazu pomiędzy trybami. Załóżmy, że w 1600x1200 pierwsza karta zachowuje płynność a druga już nie. Nie należy twierdzić, że pierwsza jest dwa razy szybsza, bo na drugiej po prostu nie da się grać w tym trybie i trzeba "zejść" np. na 1280x1024. Różnica w takim przypadku sprowadza się do różnicy jakości pomiędzy tymi trybami. A jest to już w dużym stopniu zależne od konkretnej gry. W zdecydowanej większości gier tryb wyższy niż 1024x768 nie wnosi znaczącej poprawy obrazu, choć oczywiście nie jest pomijalny. Czy 1600x1200 jest w stosunku do 1280x1024 dwa razy ładniejsze? Dziwne pytanie i w zasadzie bez odpowiedzi, ale myślę, że niektórzy już wiedzą, o co mi chodzi. Również porównanie tych dwóch kart w 1280x1024 może prowadzić na manowce wydajnościowe. W przypadku silniejszej karty może okazywać się, że momentami "czeka" ona na system i wynik nie odzwierciedla jej wydajności. Wróćmy do GeForce3.

Anizo Off

|

Anizo Bilinear

|

Anizo Trilinear-8 Tap

|

Anizo 16-32 Tap |

Anizo 32-64 Tap |

Każda kolejna generacja, procesorów graficznych wprowadza możliwość obsługi sprzętowej nowych efektów 3D. Podzielę je nieco nietypowo na te, które polepszą nam obraz już teraz oraz te, które zrobią to w bliżej nieokreślonej przyszłości. Zakrawa to na ironię, ale bynajmniej nie o to chodzi. Aby efekt można było zobaczyć w konkretnej grze to najpierw musi być dostępny sprzęt do jego wykorzystania. Dobry, nowy, programowy silnik 3D, który zasili kilka szlagierowych gier powstaje parę lat i konkretne efekty możemy zobaczyć szybciej jedynie, jeśli przypadkowo uda się je zaimplementować w końcowej fazie programowania lub w postaci prostego uaktualnienia silnika. Na dobrą sprawę, jeśli na realne wykorzystanie nowego efektu mielibyśmy czekać ponad dwa lata (a nawet rok) to taki zakup traci sens a co za tym idzie zatrzymamy maszynę rozwoju. Dlatego też producent musi nam również zapewnić namacalne korzyści z nowego cacka w odniesieniu do naszych aktualnych gier. W dalszej części chciałbym się skoncentrować na tych doraźnych zaletach karty GeForce3. Zainteresowani przyszłością mogą sobie doczytać o zaletach infiniteFX Engine w materiałach publikowanych przez nVidia oraz ściągnąć kilka demonstracji. No dobrze, mała dygresja. Programowalna jednostka cieniowania pikseli (PixelShader), zgodna z Dx8. ATI R200 (Radeon 8500) robi to niestety po swojemu (nie ważne czy lepiej). Programiści twierdzą, że stanie przed nimi dylemat czy robić to wg Dx8 (metoda nVidia) czy wg Dx8.1 (metoda ATI). Rozumiem kwestię rozwoju, ale to nie wróży dobrze. Niestety takie "kwiatki" zdarzają się już teraz (np. dedykowany EMBM). Wróćmy do aktualnych możliwości.

Na początek wspomniany wcześniej EMBM. Najładniejszy chyba efekt mapowania "wybojów" rozsławiony przez Matroxa. Niestety pomimo stosunkowo długiego życia wciąż nie doczekał się szerokiego stosowania (brak w poprzednich GeForce miał pewnie spory wpływ). Zdarzają się niestety przypadki, niekompatybilności, z GF3, ale i tak występują one rzadziej niż przy Radeonach (w sterownikach Dx8 ATI całkowicie zrezygnowało ze wsparcia tzw. EMBM + Lighting czyli metody Matroxowej). Generalnie sugeruję stosować gdzie tylko się da, bo efekt wart jest tego. Przejdźmy do najważniejszego. Wraz ze zmianami w architekturze umożliwiającymi mapowanie czterech tekseli na jeden piksel zwiększono znacząco przepustowość pamięci (DDR 3.8ns + Lightspeed Memory Architecture). Dało to w rezultacie możliwość uzyskania płynności w wyższych niż jakakolwiek karta wcześniej trybach. Zwiększenie rozdzielczości jest najprostszą a zarazem często bardzo skuteczną metodą polepszenia jakości obrazu. Możliwości karty są tak duże, że w większości gier możemy się cieszyć trybem 1600x1200 przy bezkompromisowych ustawieniach ilości detali. W pierwszym rzędzie skorzystają na tym oczywiście posiadacze wysokiej klasy monitorów. Jeśli jednak mamy monitor słabszy to również i dla nas przewidziano parę możliwości. Oczywiście w przypadku gier, które tracą na GF3 płynność powyżej 1024x768 mamy niewielkie pole manewru, ale jeśli w tych rozdzielczościach zostaje karcie spory, niewykorzystany potencjał to możemy wykorzystać pełnoekranowy antyaliasing lub filtrowanie anizotropowe. Obie funkcje możemy wymusić odpowiednim ustawieniem w sterownikach i nie wymagają wsparcia od strony samej gry (np. Radeon ma wymuszenie anizotropa tylko w OpenGL). Zacznę od antyaliasingu.

Fsaa Off

|

Fsaa 2 Samples

|

Fsaa Quincunx |

Fsaa 4 Samples |

Charakterystyczne "schodki" zniekształcające ukośne krawędzie obiektów można eliminować tzw, supersamplingiem. Oprócz znanych wcześniej wyliczeń opartych na dwóch i czterech samplach dochodzi w GF3 metoda zwana Quincunx. Wg zapewnień producenta układu oraz z testów internetowych przebija informacja, że Quincunx w uproszczeniu, daje wygładzanie zbliżone do 4-samplowego (4x), ale bez charakterystycznego upadku mocy, zmuszającego do znacznego zmniejszenia rozdzielczości. Z takim stwierdzeniem mogę się zgodzić, ale z bliżej mi nieznanych przyczyn nikt nie zwraca odpowiedniej uwagi na to, że Quincunx rozmazuje obraz. Jak dla mnie najsensowniej jest wykorzystywać Fsaa 2-samples (2x). W większości przypadków nie powoduje to konieczności zmiany rozdzielczości a jeśli już, to najwyżej o jeden tryb (np. z 1600x1200 na 1280x1024). Wprawdzie efekt jest niewielki, ale moim zdaniem wart stosowania. Inną możliwością poprawy jakości obrazu jest filtrowanie anizotropowe. Raczej zwykliśmy większą uwagę poświęcać Fsaa a moim zdaniem lepszy efekt da nam przeznaczenie nadwyżki mocy karty na dokładniejszy rendering. W wielu przypadkach uzyskamy nawet większą jakość szczegółów niż przy zwiększeniu rozdzielczości. Sterowniki umożliwiają wymuszenie anizotropa na kilku poziomach: wyłączony, bilinear, 8 tap/trilinear, 16/32 tap oraz 32/64 tap. Dokładniejsza analiza poszczególnych poziomów prowadzi mnie do następujących wniosków. Po pierwsze nie udało mi się wykryć różnicy w obrazie pomiędzy trybami 16/32 a 32/64. Jedynym efektem było większe obciążenie karty. Możemy więc spokojnie odpuścić sobie 32/64 tap. Po drugie eksponowany przez marketing nVidia tryb 8 tap/trilinear (ATI go nie obsługuje) jak dla mnie nie ma sensu, bo dokładnie ten sam efekt można uzyskać w trybie 16/32 tap a zyskujemy na mniejszym spadku mocy. Podsumowując wybierajmy pomiędzy trybem bilinear a 16/32 tap. Ten pierwszy, jako, że realizowany jest przez kartę GF3 niemal "darmowo" można mieć włączony domyślnie podobnie jak i Fsaa 2x. Dołączyłem stosowne powiększenia fragmentów zrzutów ekranów (pełen screenshot po kliknięciu), aby każdy mógł porównać znaczenie obydwu efektów (mimo kompresji jpeg można zauważyć różnicę). Kończąc te rozważania chciałbym tylko wyrazić swój żal, że nVidia przy okazji stworzenia nowego układu nie poprawiła słynnego błędu Dxt1 (16 bitów zamiast 32 w skompresowanych teksturach) i jeśli ktoś wykorzystuje kompresję to warto wymusić (rejestr, tweaker) na sterownikach przejście na model Dxt3.

Podsumowanie

Gainward GeForce3 PowerPack !!! "Golden Sample" zrobił na mnie korzystne wrażenie. Wśród innych kart GF3 wyróżnia go bogactwo wyjść i dobra jakość obrazu. Natomiast osobiście polecałbym jednak wersję Gainwarda z samym wyjściem telewizyjnym, bo układ VIVO w wykonaniu Philipsa czasem wręcz obniża funkcjonalność. Otwarte pozostaje jednak pytanie o zasadność kupowania karty z układem GeForce3 (niezależnie od producenta). Na pierwszym miejscu stawiam zasobnych graczy wyposażonych w wysokiej klasy monitory (19" i większe). Oni zyskają najwięcej. Na drugim miejscu są Ci, którzy chcą kupić kartę, która ma w założeniach służyć dłuższy okres czasu (nie podejmuję się określenia jego długości). Sądzę jednak, że w świetle ostatnich prezentacji ATI i nVidia grono zwolenników tego układu znacznie się zmniejszy. Miłośnicy bezkompromisowego high-endu zainteresują się kartami GF3 Ti/500 i ATI Radeon 8500 a układ GF3 ma szansę trafić "pod strzechy" w postaci GF3 Ti/200 i stać się przebojem rynku.

Kartę graficzną dostarczyła firma: Kartę graficzną dostarczyła firma:

|

|

|

Multimedia Vision

|

|

|

|

|

|

|

|

|

|

K O M E N T A R Z E |

|

| |

|

- super karta (autor: Seba000 | data: 29/10/02 | godz.: 12:31)

wiem bo sam mam mi chodzi na 250/550 POLECAM!

|

|

|

|

|

|

|

|

|

D O D A J K O M E N T A R Z |

|

| |

|

Aby dodawać komentarze, należy się wpierw zarejestrować, ewentualnie jeśli posiadasz już swoje konto, należy się zalogować.

|

|

|

|

|

All rights reserved ® Copyright and Design 2001-2024, TwojePC.PL |

|

|

|